简单部署私域大模型

构建家庭智能助手。

Windows 安装 Ollama

首次运行ollama run llama3.1,会联网加载模型。可以选择的模型有:

| Model | Parameters | Size | Download |

|---|---|---|---|

| Llama 3.1 | 8B | 4.7GB | ollama run llama3.1 |

| Llama 3.1 | 70B | 40GB | ollama run llama3.1:70b |

| Llama 3.1 | 405B | 231GB | ollama run llama3.1:405b |

| Phi 3 Mini | 3.8B | 2.3GB | ollama run phi3 |

| Phi 3 Medium | 14B | 7.9GB | ollama run phi3:medium |

| Gemma 2 | 2B | 1.6GB | ollama run gemma2:2b |

| Gemma 2 | 9B | 5.5GB | ollama run gemma2 |

| Gemma 2 | 27B | 16GB | ollama run gemma2:27b |

| Mistral | 7B | 4.1GB | ollama run mistral |

| Moondream 2 | 1.4B | 829MB | ollama run moondream |

| Neural Chat | 7B | 4.1GB | ollama run neural-chat |

| Starling | 7B | 4.1GB | ollama run starling-lm |

| Code Llama | 7B | 3.8GB | ollama run codellama |

| Llama 2 Uncensored | 7B | 3.8GB | ollama run llama2-uncensored |

| LLaVA | 7B | 4.5GB | ollama run llava |

| Solar | 10.7B | 6.1GB | ollama run solar |

WebUI

- Windows 下安装 ollama,并至少导入一个模型配置

- Web UI github

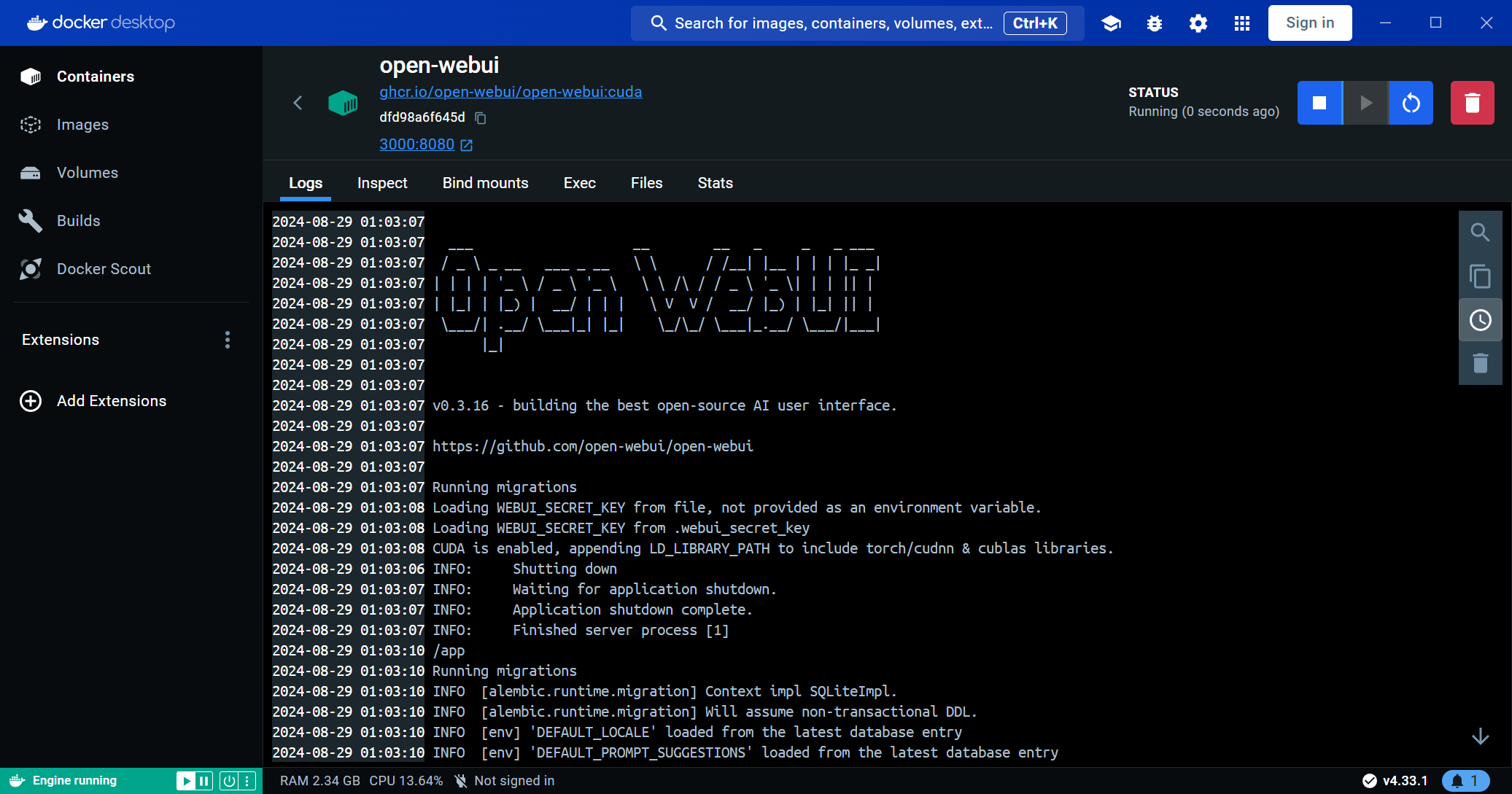

- Windows 下安装 Docker Desktop,更新到最新版

- Docker 已经被墙,下载较为麻烦

- 旧版本可能存在的Bug:

- 参考:WSL 安装 Cuda

- Docker 拉取 WebUI docker 镜像,注意此时 Docker Desktop 必须运行

如何进入powershell:

- win+R,进入“运行”,输入powershell

- 或者右键左下角win图标,选择终端

1 | |

https://docker.aityp.com/image/ghcr.io/open-webui/open-webui:main

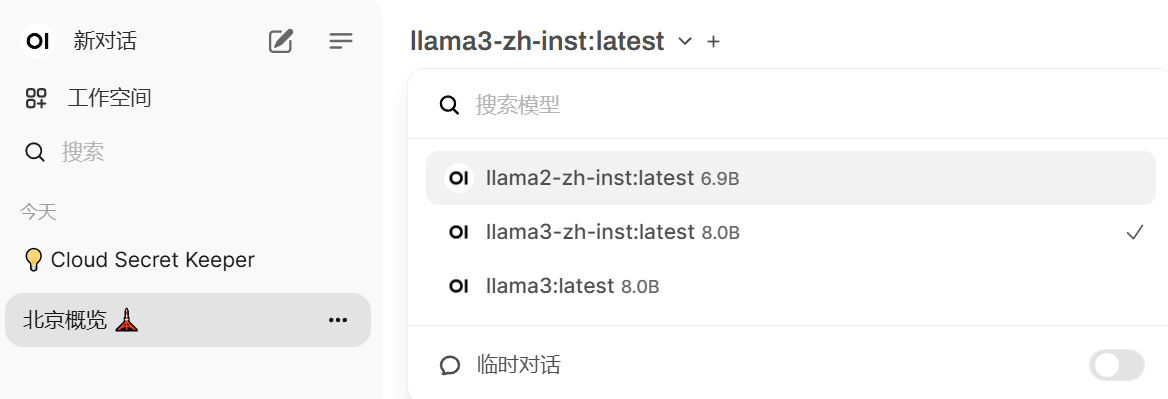

打开:localhost,可以切换选择模型,可以作为日常知识的获取途径。

手机连接

- 保证手机和电脑连在同一个局域网下

- 在powershell中运行

ipconfig,查看IP地址,一般为192开头 - 假设IP为

192.168.1.1,在手机浏览器中输入192.168.1.1:3000 - Iphone手机可以将此网页保存到桌面