ragflow 使用

Ragflow 是一个开源的 RAG(Retrieval Augmented Generation)框架,它提供了一套完整的工具和组件,用于构建和部署 RAG 解决方案。

Ragflow 提供了以下功能:

- 检索:检索和获取相关数据

- 生成:生成文本

- 评估:评估生成的文本

- 存储:存储生成的文本和数据

- 集成:与各种工具和组件集成

- 部署:部署 RAG 解决方案

- 文档:提供文档和教程

- 社区:提供社区支持和讨论

Ragflow 有以下部署方式

- 本地部署:在计算机上运行 Ragflow,使用本地服务器和数据库进行部署。

- 容器部署:使用 Docker 容器进行部署,使用 Docker 容器进行部署。

- 云部署:在云平台(如 AWS、Azure、GCP)上进行部署,使用云平台进行部署。

- 在线使用

使用本地部署,需要本地提供算力,解析 OCR 文字识别,需要至少 30 GB 存储空间。优势是本地部署大大保证了用户文档隐私。

接下来主要介绍在线使用

创建 api

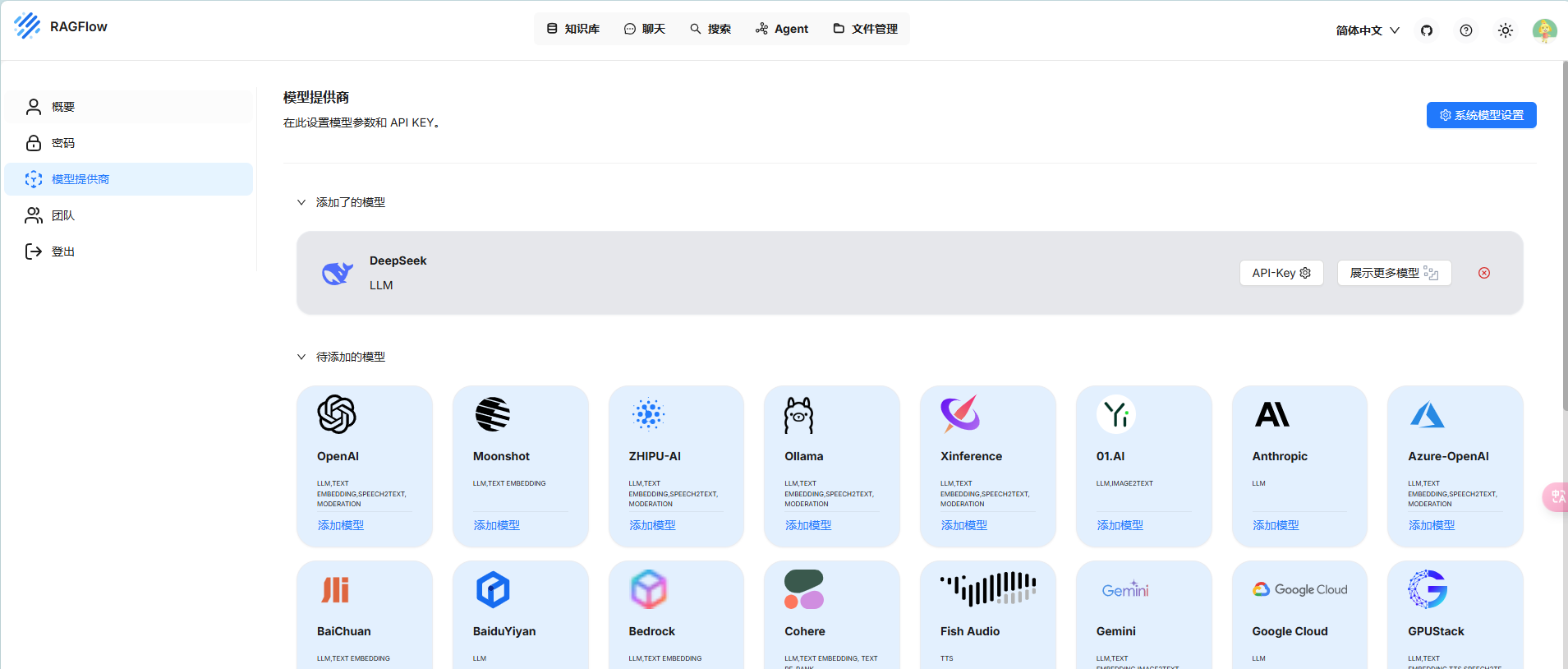

注册账号,进入后,点击右上角,选择 “模型供应商”

找到下面的 deepseek:

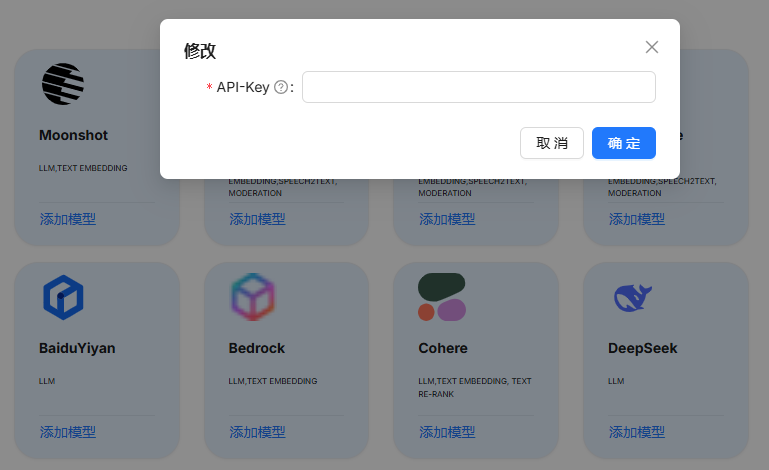

提示需要 api key,找到 Deepseek API keys,登账号获取密钥:

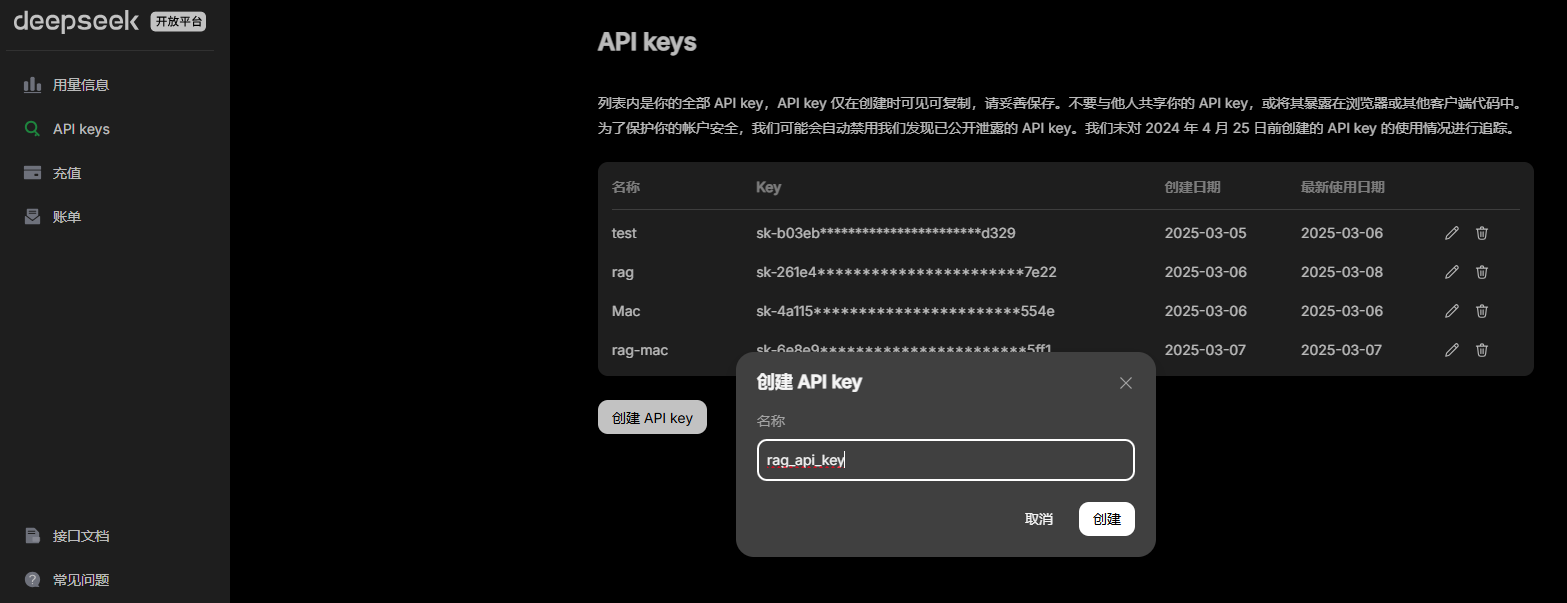

随便起个名字,比如 rag_api_key,不要忘记点击复制 api key。

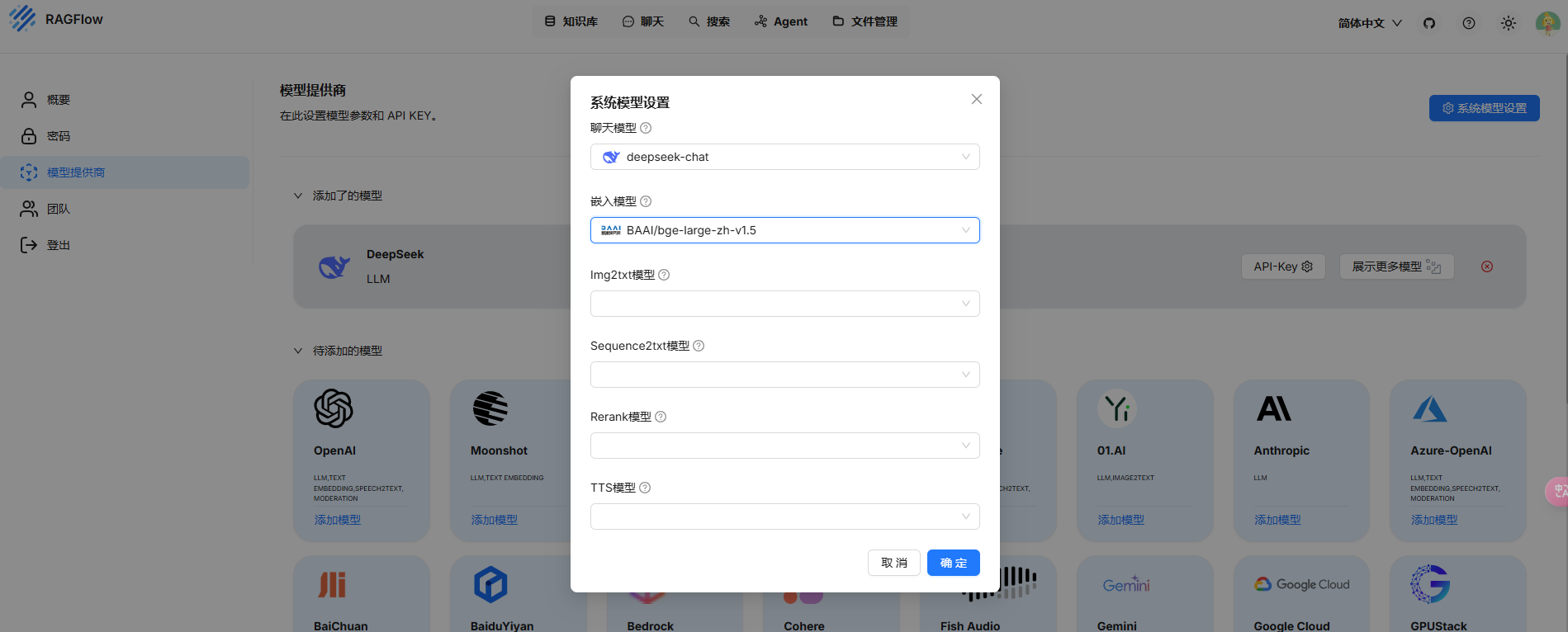

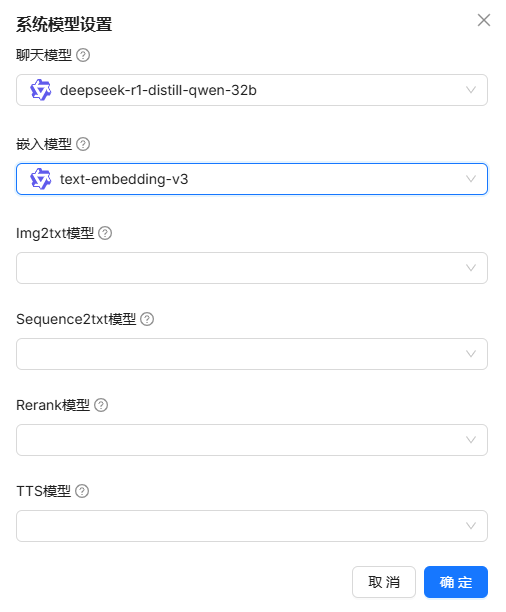

到刚刚 ragflow 页面粘贴密钥粘贴。完成后,点击右上角系统模型设置,设置如下:

聊天中,选择 deepseek-reasoner(r1) 会贵一些,deepseek-chat 比较便宜,不要忘记充值余额,十块钱可以用 deepseek-chat 很久:

价格如下,夜里用是半折,r1 则是2.5折。

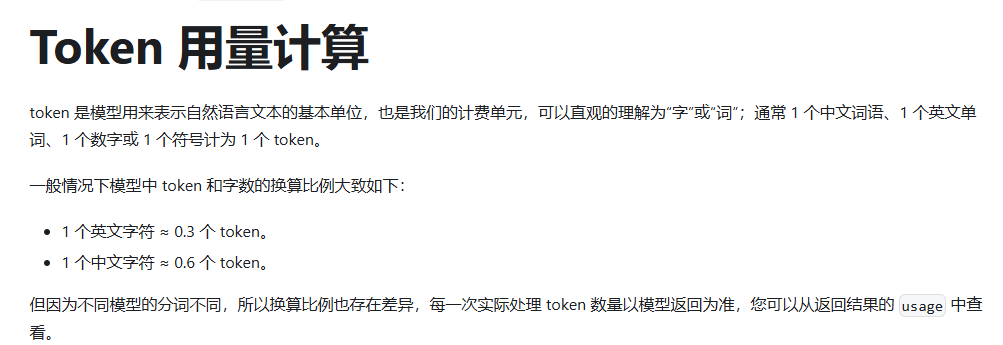

Token 计算如下,百万token = 166 万汉字 = 100 万词语 = 100 万数字 = 100 万单词

差不多一次对话一两分钱。

添加第三方文档解析模型

官方服务器太慢,考虑使用第三方 OCR,风险在于可能有些文档无法正常解析。

进入阿里云百炼,使用你的支付宝登陆。找到 API-KEY,

创建key,点击查看,复制 key。如果创建遇到问题,根据提示开通相关服务,并且完成实名认证。

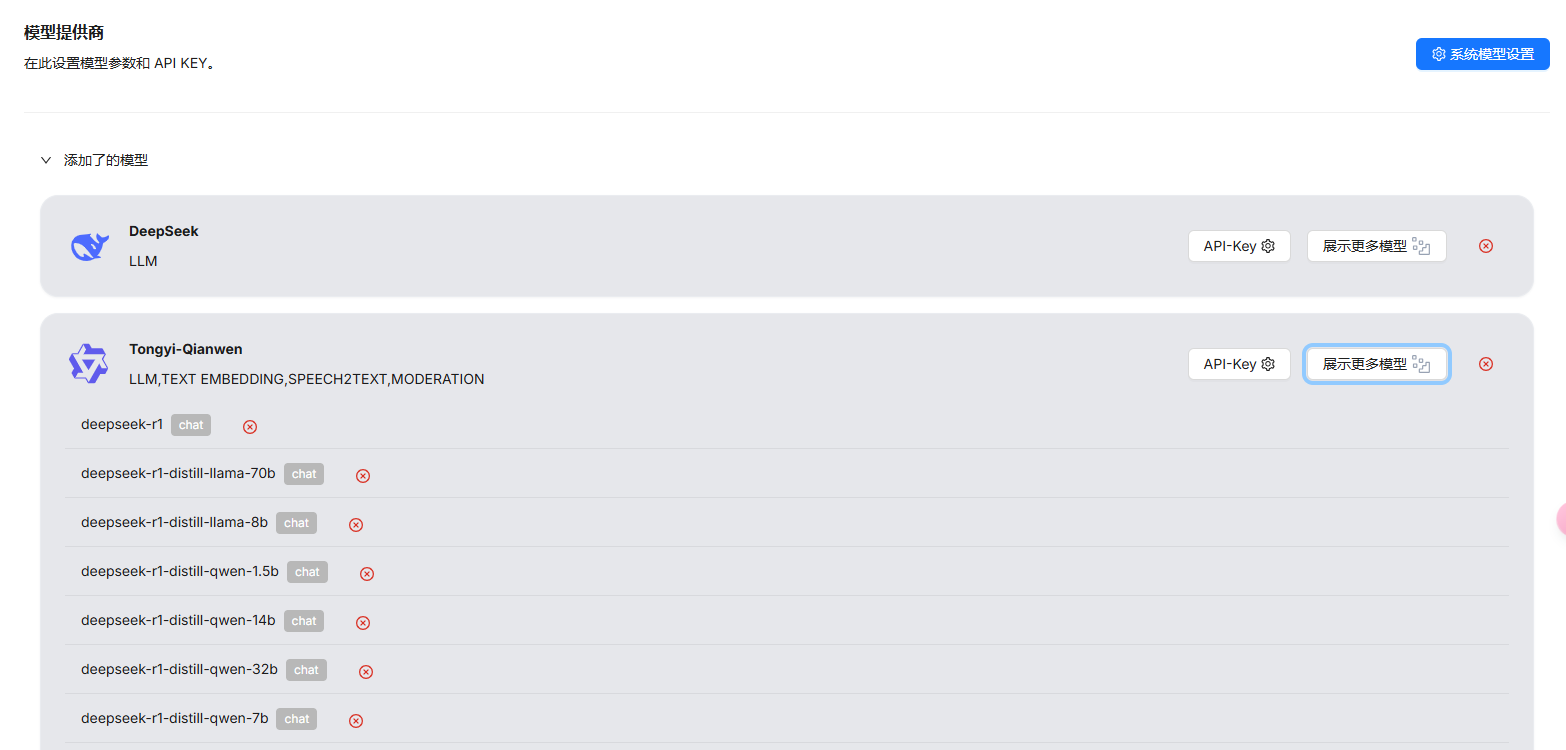

返回到 ragflow 的模型设置页面,找到 Tongyi-Qianwen,并添加 key。完成后可以看到模型:

系统模型设置页面替换为:

这里的对话模型可以替换为阿里的模型,相对deepseek满血的模型,响应更快,模型精度些许下降,不过完全够用。当然也是收费的,可以再阿里云中充值,价格和deepseek官方差不多。

注:下面的测试结果仍然是deepseek-chat版的回答。

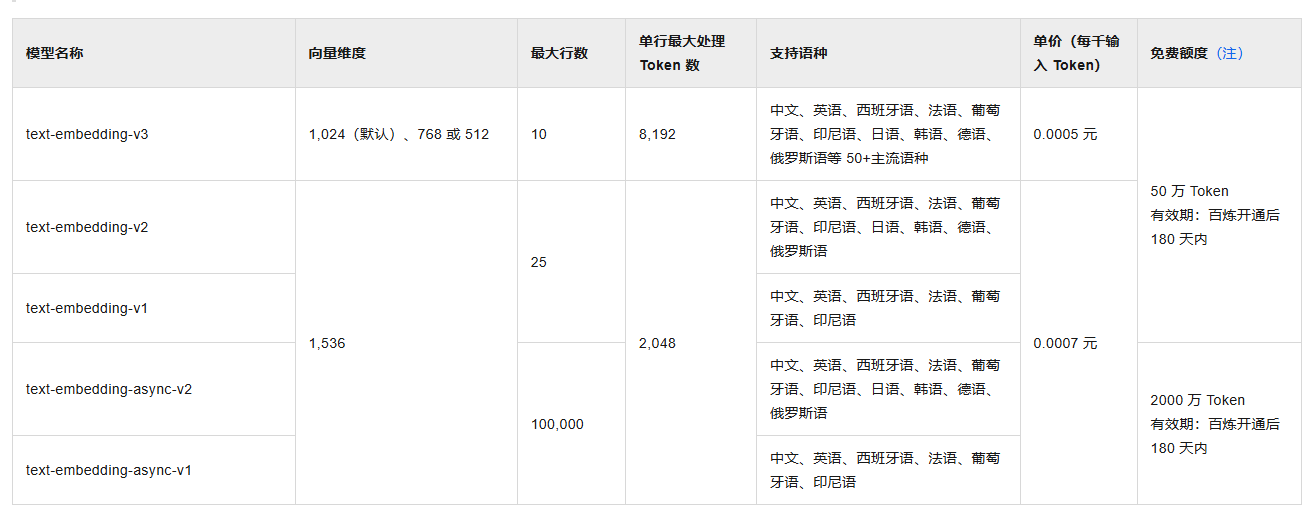

有关 embedding-v3的价格:

刚开通有一定的免费额度,后面需要向阿里云账号充钱。

创建知识库

点击上方知识库,右边创建知识库:

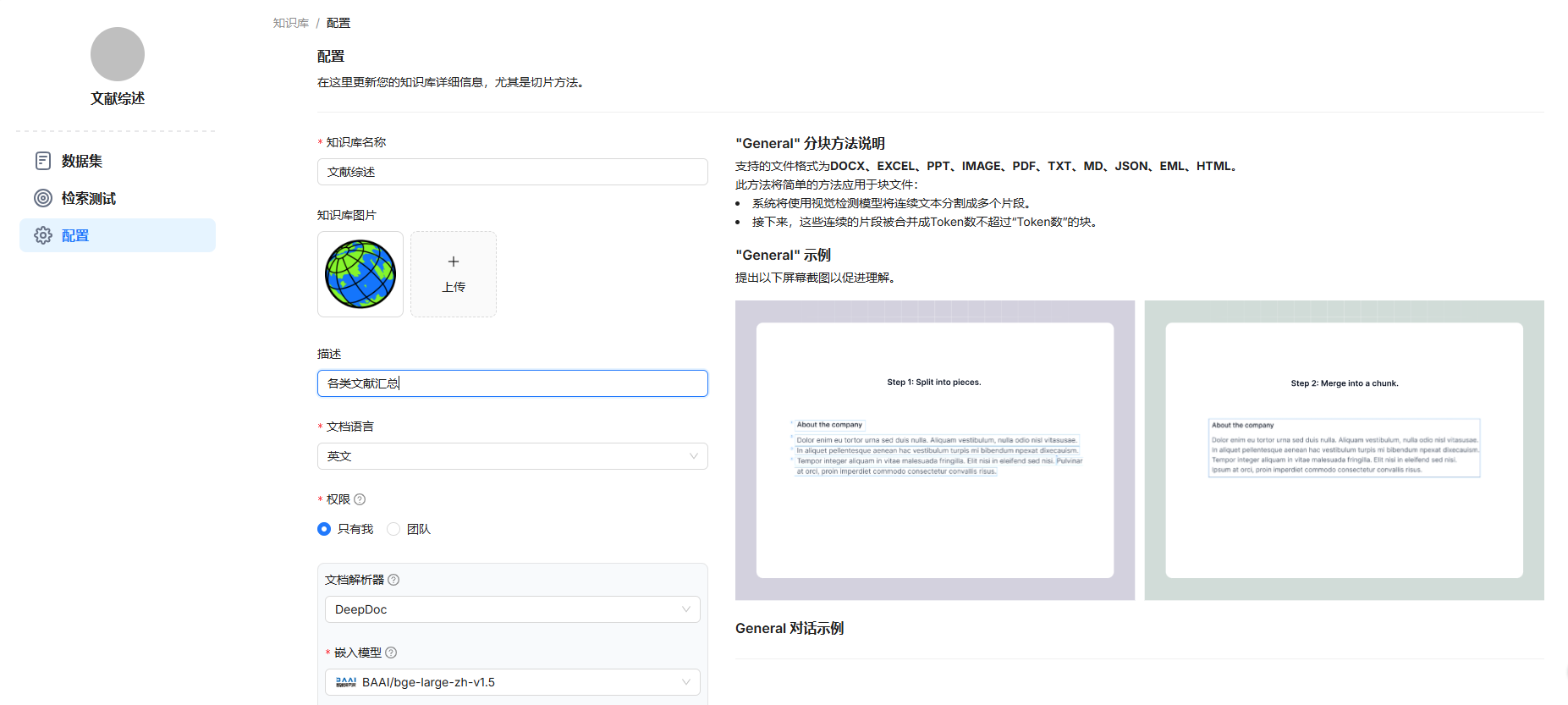

若无特殊需求(例如最下方创建知识图谱,实测会大大增加对话模型的 token 消耗,且文档解析会慢很多,并无太大用处),大部分选择默认配置,也可以添加一个图片和描述:

文档解析模型选择阿里的模型:

然后拉到最下方保存。

添加数据

点击知识库,选择“数据集”,点击“新增文件”:

可以上传单个文件,word、ppt、pdf格式都可以,也可以上传文件夹:

浏览器会弹出提示:

这样就一次性上传了多个文件:

如果你文件夹有无关的文件,如图片,可以在下面已上传文件点击删除按钮。如下所示“

耐心等待上传完成,如果卡在 1% 不动,看到后面已经新增了文件即可点击右上角 X 退出弹窗:

注意不要再点确定按钮,不然又上传了一遍,卡壳是服务器问题,实际已经上传完成。

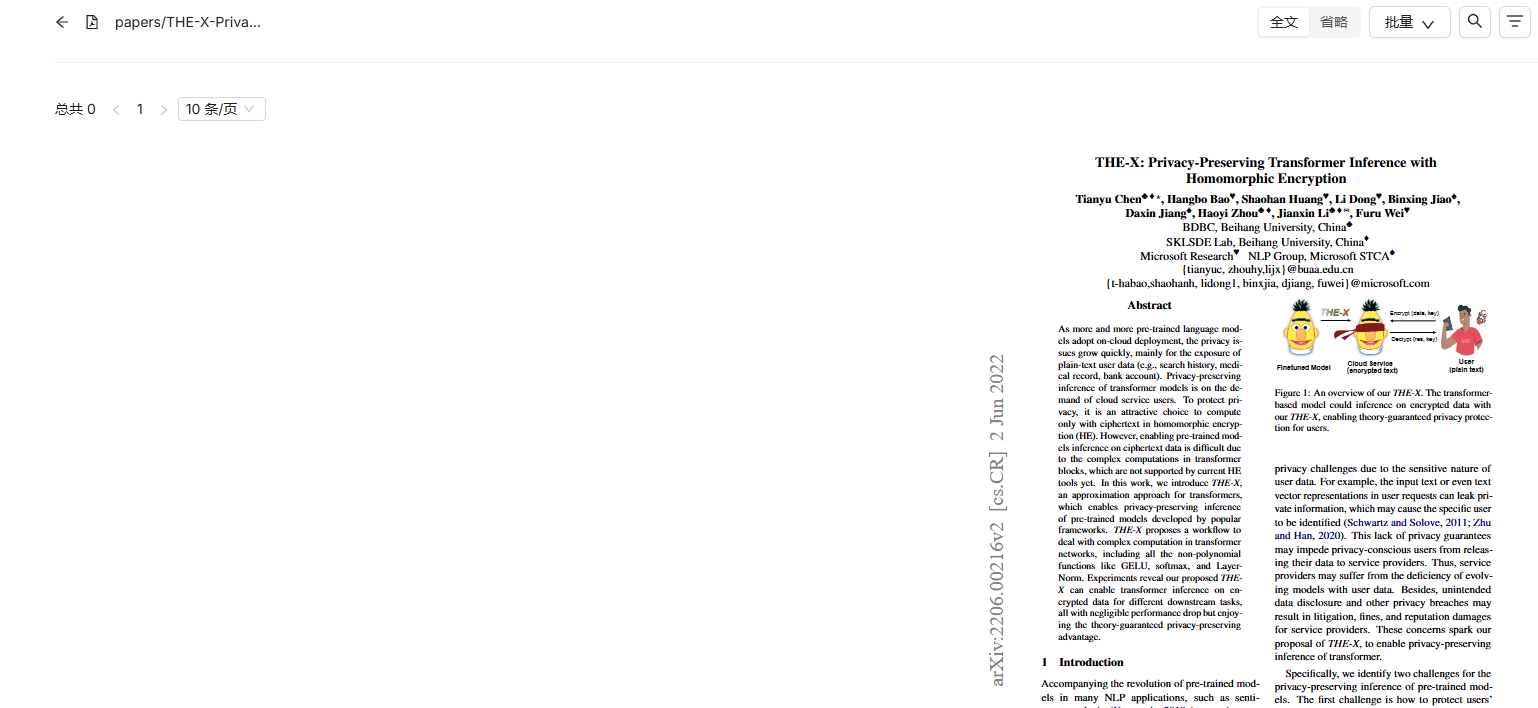

随便点进一个文档:

查看是否上传成功:

进入上一级,全部选择,点击“批量”,选择“解析”:

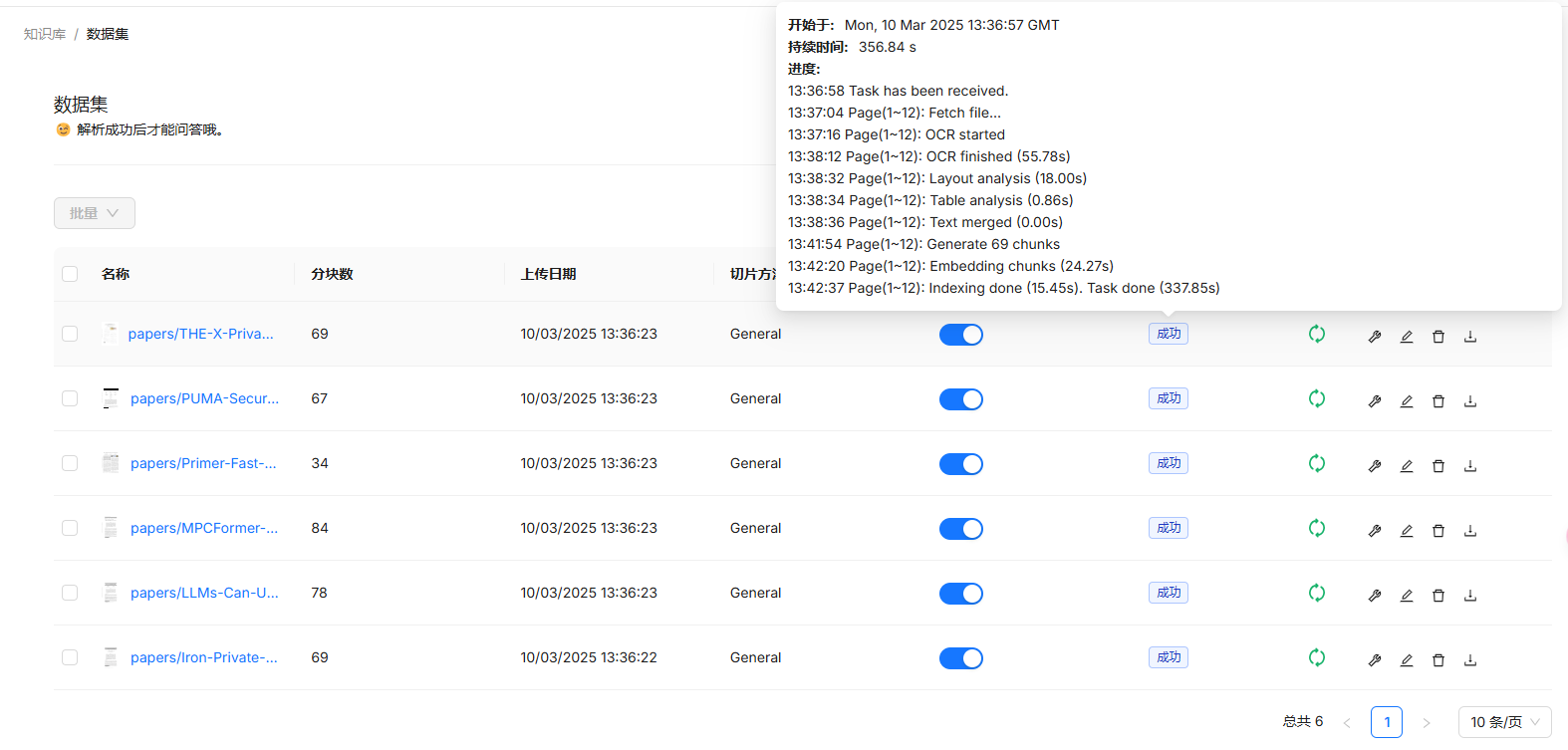

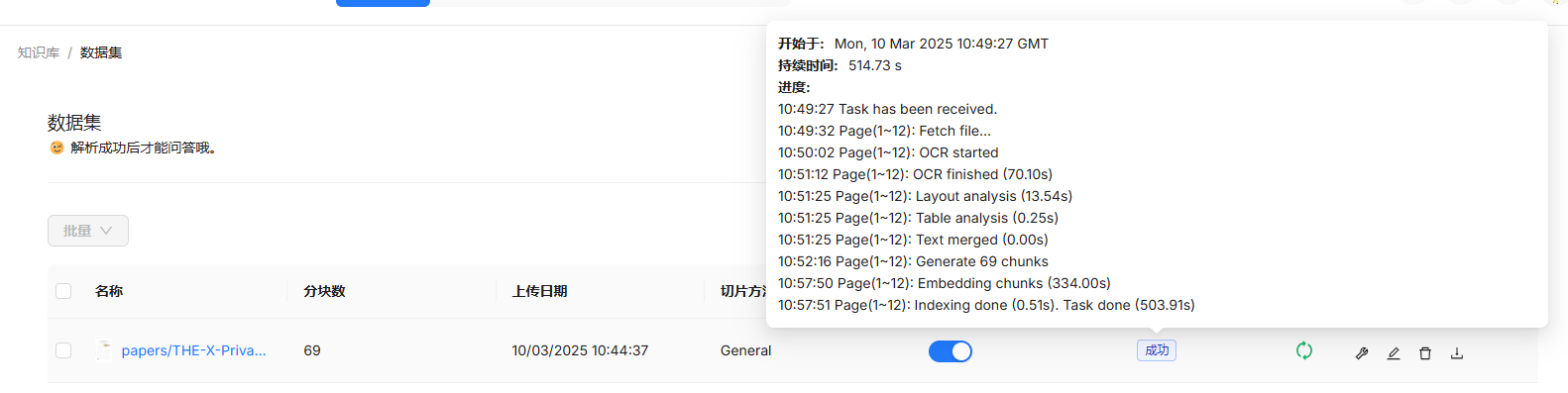

可以查看解析过程的返回:

文献越长,解析越久。不过阿里的解析模型已经大大加快了解析速度。一个文档综合下来几分钟就可以解析完成。如果失败了,则点击解析,弹出提示“是否删除所有块”,点击“是”进而重新解析。有时候有的文档就是解析不了,所以失败多次就放弃这个文档,删除了事。点击已经解析的文件:

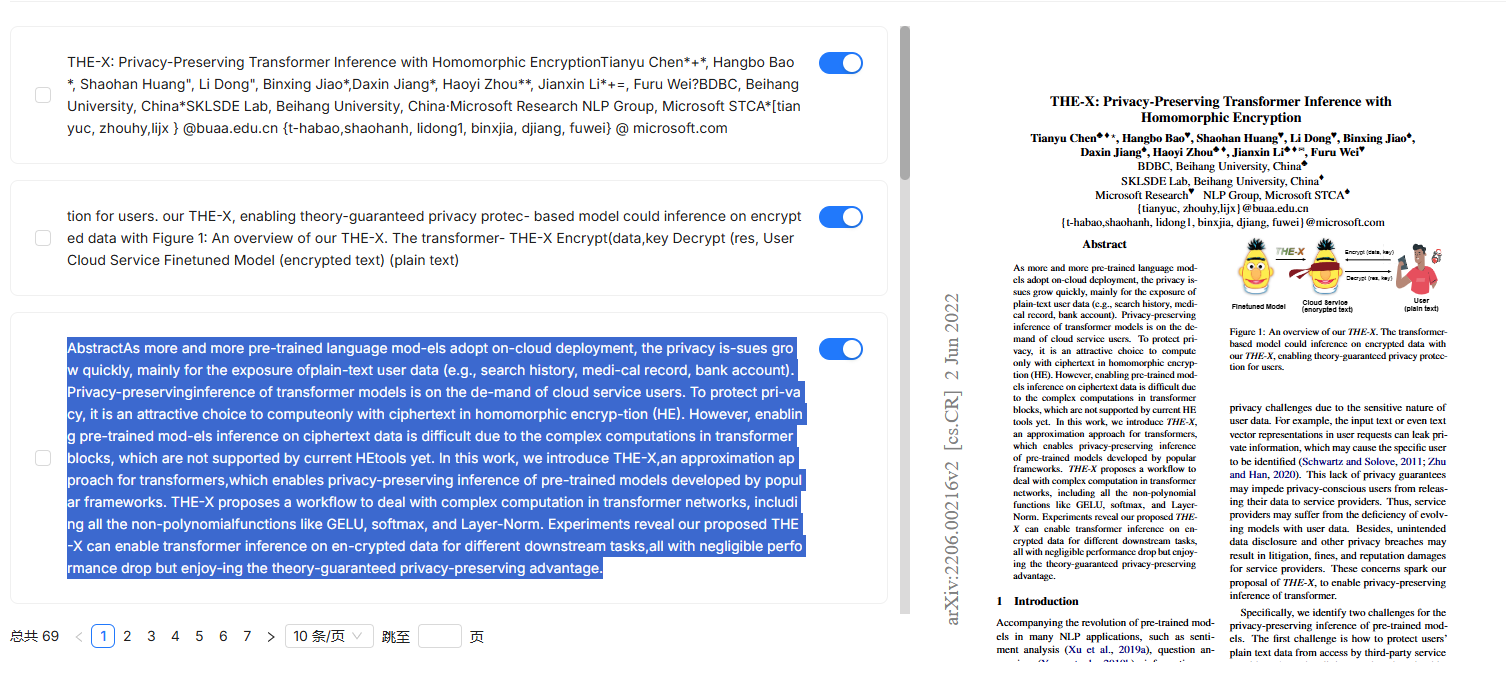

看到文档的摘要正确的 OCR 解析了:

创建对话

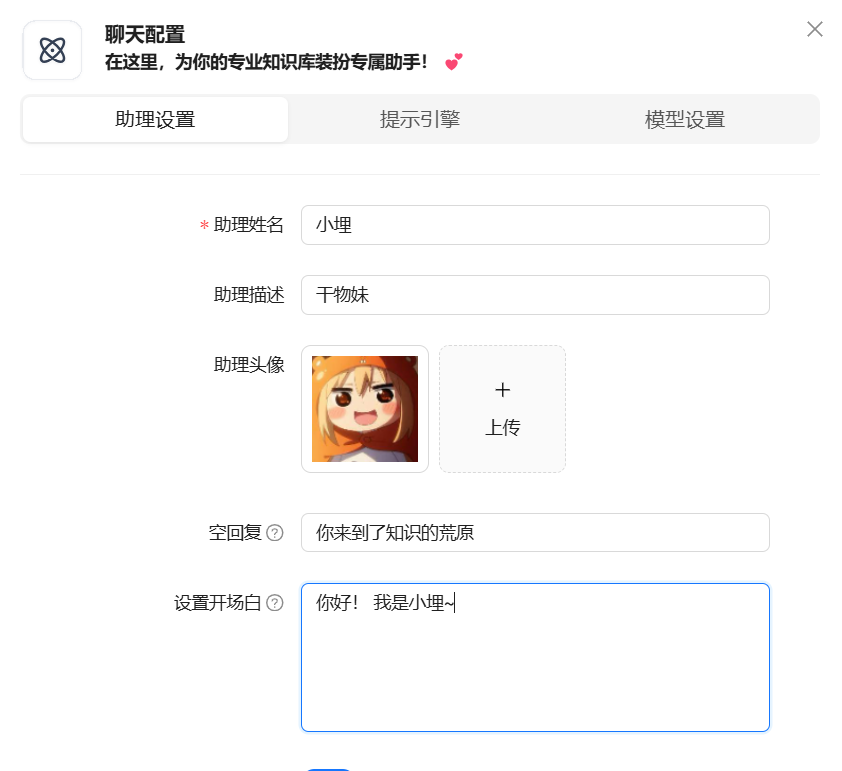

点击聊天,点击新建助理,你可以定制你的对话助理:

最下方知识库绑定已经创建的知识库,如果有多个,可以多选:

点击模型设置,可以选择是chat 还是 reasoner,或者阿里的模型:

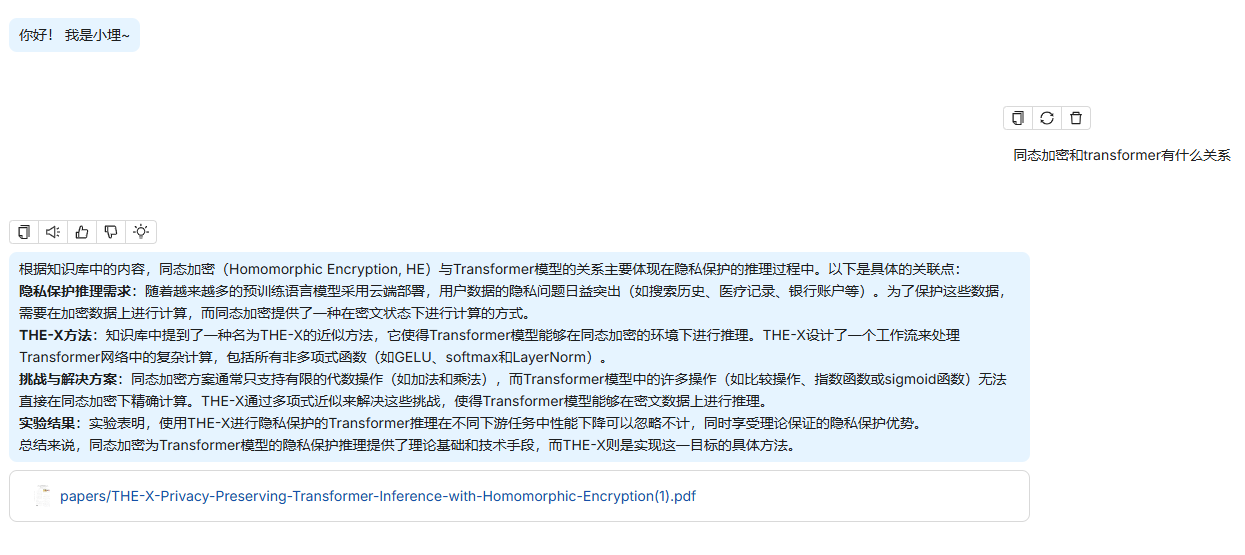

点击确定,保存助理。点击新建聊天,测试问题,比如已经解析的文档标题是同态加密相关的,询问,同态加密和transformer有什么关系:

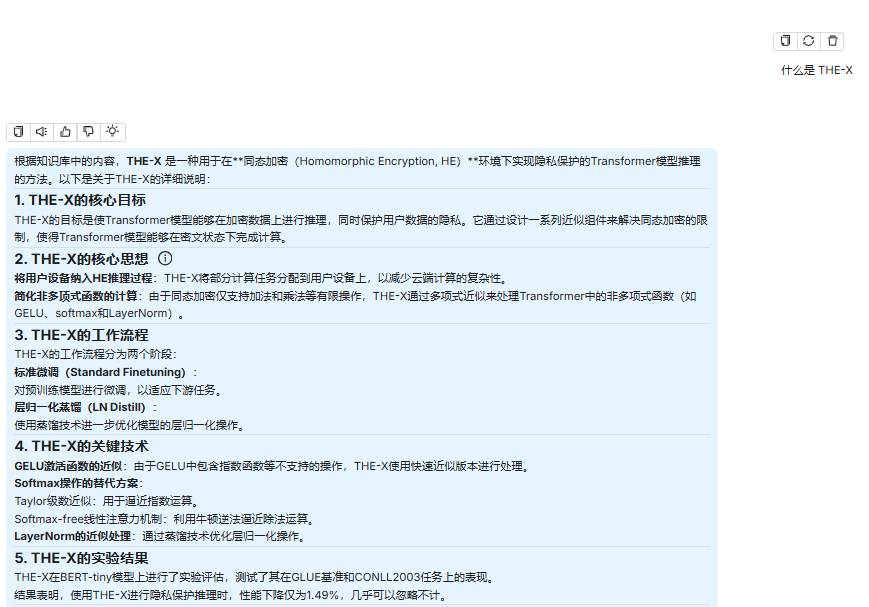

进一步追问:

可以查看到引用的位置:

打开小图:

找到检索到的位置:

实测阿里的对话模型,先将助理的对话模型更改为 deepseek-r1-distill-qwen-32b:

然后重新创建对话,询问问题:

模型吞吐较快,且包含了推理。

搜索

搜索建立在你对知识库的文档有大体的了解,主要搜一搜关键词,实测引用位置可能会产生错误。搜索后,及时保存结果,切换页面后结果将丢失。

思维导图

搜索完成后,点击右边回形针按钮,可以创建思维导图,比较鸡肋。

尾声

AI 工具的输出只能当作参考,不能完全相信。

非本地的rag服务器,属于官方的demo性质,可能随时删除服务器跑路,可靠一些还是使用本地部署。部署完成后,本地的页面上的模型配置和使用和上述一致。